Как искусственный интеллект может дискриминировать людей по расе

Как искусственный интеллект может дискриминировать людей по расе

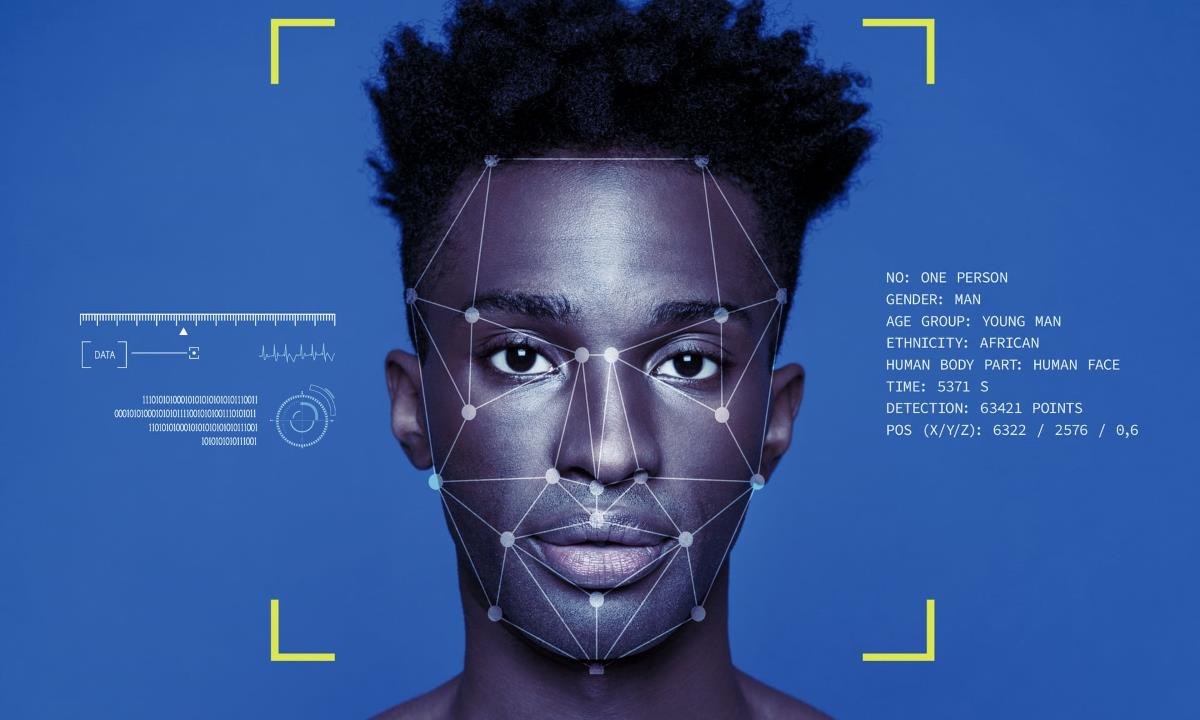

Системы искусственного интеллекта, которые могут «читать» выражения лиц, основаны на устаревших научных методиках. Они могут дискриминировать людей, утверждает один из ведущих мировых экспертов по психологии эмоций.

По словам Лизы Фельдман Барретт, профессора психологии в Северо-Восточном университете Бостона, технологии ИИ игнорируют новейшие подтверждения того, что в разных культурах выражения лиц не являются универсальными. Из-за этого технологии, которые уже применяются в алгоритмах ИИ, рискуют быть ненадежными, рассказывает The Guardian.

«Я не знаю, как компании могут продолжать оправдывать то, что они делают, когда действительно ясно, что есть доказательства», — отметила Барретт. Ученая предупреждает, что системы распознавания эмоций, основанные на ложных алгоритмах, внедряются во все большем количестве приложений. Так, искусственный интеллект, разработанный компанией HireVue, сканирует выражения лица кандидатов, язык тела и выбор слов, и сопоставляет их с признаками, связываемыми с успехом на работе.

У гиганта Amazon есть собственная система распознавания лиц Rekognition, которая может определять семь основных эмоций: счастье, грусть, гнев, удивление, отвращение, спокойствие и растерянность.

«Исходя из опубликованных научных данных, мы считаем, что